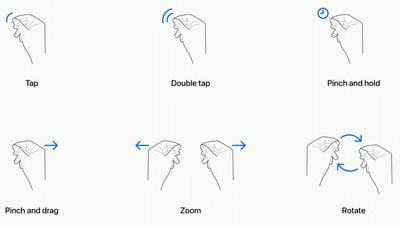

Image Credit:These Gestures Are How You Control Apple Vision Pro

Appleの新しい「空間コンピューティング」デバイスであるApple Vision Proは、ハードウェアを使ったコントロールメカニズムを持っていません。手のジェスチャーと視線追跡に頼って、仮想空間上のオブジェクトを操作することができます。アップルのデザイナーたちは開発者セッションにて、Vision Proで使用可能な具体的なジェスチャーや、その相互作用法を説明していました。

・タップ:ツムと人差し指を合わせることで、そのオブジェクトにタップをするというシグナルがヘッドセットに送られます

・ダブルタップ:二度タップするとダブルタップジェスチャーが起動されます

・ピンチ&ホールド:テキストをハイライトするなど、タップ&ホールドとの類似点があります

・ピンチ&ドラッグ:スクロールやウィンドウの移動に使用できます。縦方向や横方向のスクロール可能であり、手を速く動かせばより早くスクロールできます

・ズーム:二つのメインの「両手」ジェスチャーのうちの一つ。指を結び合わせて手を前後に動かすことでズームできます。ウィンドウサイズも角をドラッグすることで調整できます。

・回転:ジェスチャーチャートに記載された内容によると、指を結びうえて手を回転させることで仮想空間のオブジェクトを操作できます

これらのジェスチャーは視線の動きと組み合わせて使用されます。Vision Proに多数搭載されているカメラがあなたの視線を非常に正確に追跡するため、手のジェスチャーによる対象物の操作に視線の位置が重要となります。例えば、アプリアイコンや画面に表示されている要素を見ることで、これを対象にし、ジェスチャーを利用して操作を行うことが可能です。ジェスチャーは大袈裟でなくても機能するため、手は膝に置くことで疲れを少なくすることができます。

さらに、アプリを制御するための特別なジェスチャーも可能で、ハンドストラップなどの他の機能とも制御することができます。開発者は、アプリに対してシステムジェスチャーや一般的な手の動きとは異なるような独自のジェスチャーを作成することができます。また、手首への負担を抑え、長時間利用できるよう、より繰り返しやすく、わかりやすくすることが求められます。

接続可能なBluetoothキーボード、トラックパッド、マウス、ゲームコントローラーによって、手と目のジェスチャーをサポートすることができます。また、言葉による検索やディクテーションツールも搭載されています。

多くの人が「直感的」と評するように、Appleのデザイナーたちは、iPhoneやiPadのマルチタッチジェスチャーと同じように機能するようにVision Proを作成したようです。現在、反応は良好で、多くの人々にとって便利になっています。

Appleの新しい「空間コンピューティング」デバイスであるApple Vision Proには、ハードウェアベースのコントロール機構がありません。代わりに、ユーザーは目のトラッキングと手のジェスチャーを使用して、彼らの前の仮想空間内のオブジェクトを操作することができます。ジェスチャーは、タップ、ダブルタップ、ピンチアンドホールド、ピンチアンドドラッグ、ズーム、ローテートの6つがあります。ジェスチャーは、目の動きと一緒に機能し、カメラで正確なトラッキングができます。また、Bluetoothキーボード、トラックパッド、マウス、ゲームコントローラーがヘッドセットに接続できます。

引用元記事はこちらThese Gestures Are How You Control Apple Vision Pro